Mark Zuckerberg kündigt 'vollständig privaten' verschlüsselten Meta AI Chat an

In einer wegweisenden Entwicklung, die die Landschaft der künstlichen Intelligenz und der digitalen Privatsphäre neu definieren könnte, hat Mark Zuckerberg, CEO von Meta, die Einführung des 'Inkognito-Chats' für seine Meta AI-Plattform bekannt gegeben. Diese Ankündigung, die zu einer Zeit zunehmender Kontrolle der Datenverwaltung durch große Technologieunternehmen erfolgt, verspricht ein wirklich privates KI-Gesprächserlebnis – eine kühne Behauptung, die eine detaillierte Analyse verdient.

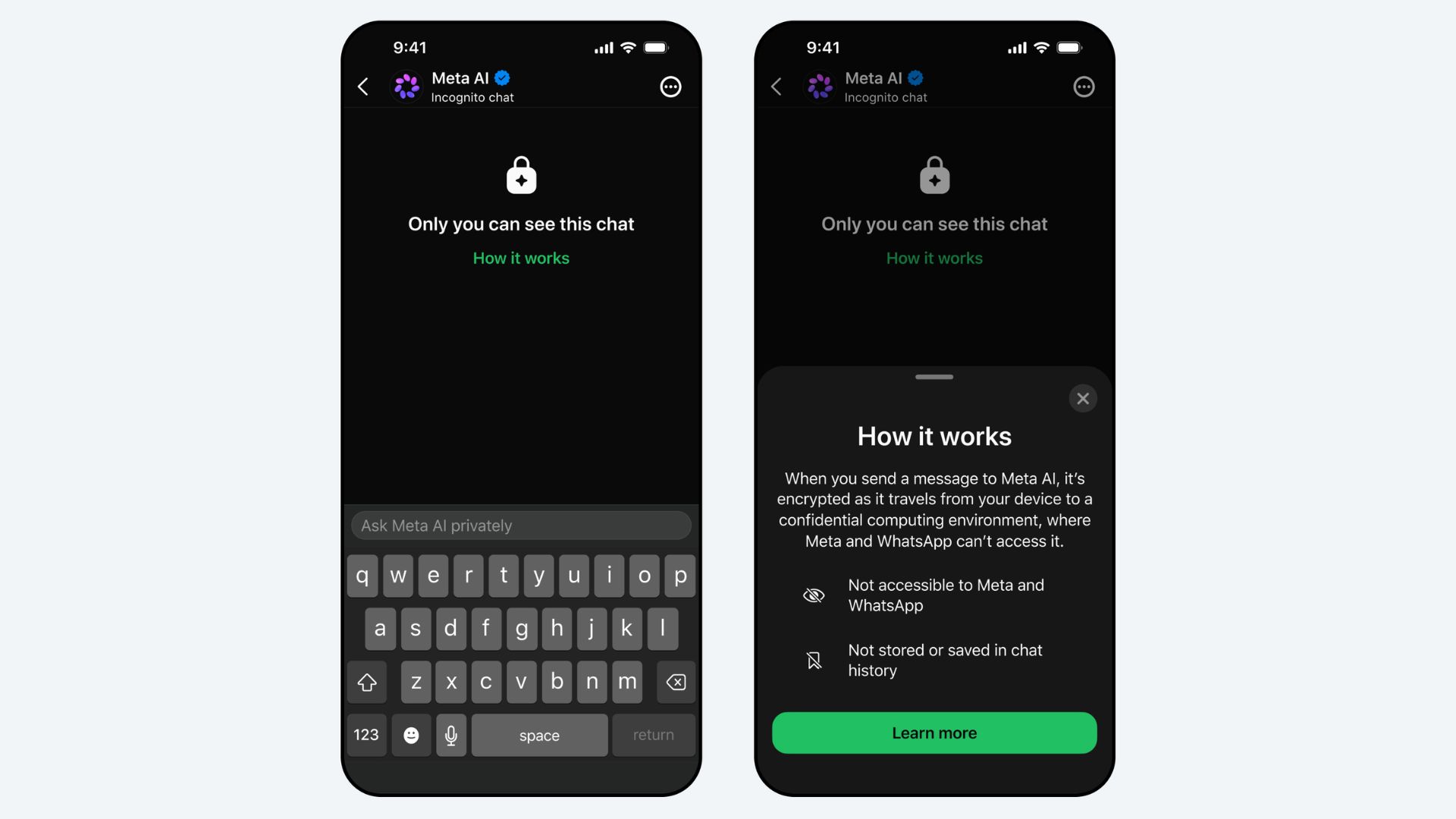

Zuckerberg hat den Inkognito-Chat als "das erste große KI-Produkt bezeichnet, bei dem keine Aufzeichnung Ihrer Gespräche auf den Servern gespeichert wird". Diese Aussage ist ein Wendepunkt, da sie direkt eine der größten Bedenken der Nutzer im Zeitalter der KI anspricht: die Beständigkeit und Zugänglichkeit ihrer Interaktionen mit generativen Modellen. Im Wesentlichen werden Nachrichten, die über den Inkognito-Chat gesendet werden, nicht im Chatverlauf der Nutzer gespeichert oder abgelegt, was die Funktionalität der Inkognito-Modi nachahmt, die wir bereits von Browsern und anderen Chatbot-Anwendungen kennen.

Metas grundlegender Unterschied: Ende-zu-Ende-Verschlüsselung

Obwohl die Idee eines Inkognito-Modus für Chatbots nicht völlig neu ist, behauptet Meta, dass seine Implementierung radikal anders und überlegen ist. Der Schlüssel zu diesem Unterschied liegt in der Integration der Ende-zu-Ende-Verschlüsselung (E2EE), einer Sicherheitsfunktion, die Meta auf seinen anderen Plattformen inkonsistent implementiert und sogar kürzlich aus Instagram Direct Messages entfernt hat. Dieser Kontrast ist bemerkenswert und unterstreicht die Ernsthaftigkeit von Metas Engagement für den Datenschutz in seinem KI-Angebot.

"Andere Anwendungen haben Inkognito-ähnliche Modi eingeführt, aber sie können immer noch die eingehenden Fragen und ausgehenden Antworten sehen", erklärte Zuckerberg. "Der Inkognito-Chat mit Meta AI ist wirklich privat, was bedeutet, dass niemand – nicht einmal Meta – Ihre Gespräche lesen kann." Dieses Versprechen einer beispiellosen 'totalen Privatsphäre' setzt einen neuen Maßstab für die Interaktion mit KI und positioniert Meta als Pionier in diesem kritischen Aspekt.

Das Gebot der Privatsphäre im Zeitalter der KI

Die Nachfrage nach Privatsphäre bei Interaktionen mit künstlicher Intelligenz ist sprunghaft angestiegen. Da KI-Modelle wie OpenAI GPT-5.5, OpenAI Claude 4.7 Opus und Google Gemini 3.1 immer ausgefeilter und allgegenwärtiger werden, werden sich die Nutzer zunehmend bewusst, wie viele Daten sie teilen und wie diese Daten verwendet werden könnten. Die Sorge um die Sicherheit persönlicher Informationen, die mögliche Monetarisierung von Konversationsdaten und die Verhinderung des Abflusses sensibler Informationen hat die Notwendigkeit robuster Lösungen wie den Inkognito-Chat vorangetrieben.

Die Implementierung der Ende-zu-Ende-Verschlüsselung in Meta AI bedeutet, dass die Gespräche zwischen dem Nutzer und dem KI-Modell vom Zeitpunkt des Sendens bis zum Empfang geschützt sind, sodass nur der Absender und der beabsichtigte Empfänger (in diesem Fall das KI-Modell auf dem Gerät des Nutzers oder eine sichere, kurzlebige Umgebung) sie lesen können. Nicht einmal Meta, der Dienstanbieter, hat die technische Möglichkeit, diese Nachrichten abzufangen oder zu entschlüsseln. Diese Architektur ist grundlegend für das Versprechen authentischer Privatsphäre.

Wettbewerb und Vergleich in der KI-Landschaft

Im wettbewerbsintensiven KI-Ökosystem ist der Datenschutz zu einem entscheidenden Unterscheidungsmerkmal geworden. Die Branchenführer haben diese Herausforderung mit verschiedenen Strategien angegangen:

-

OpenAI mit GPT-5.5: OpenAI hat seine Datenschutzrichtlinien kontinuierlich verbessert und bietet Nutzern Optionen, die Verwendung ihrer Daten für das Modelltraining zu deaktivieren, sowie 'temporäre Chat'-Modi, die den Verlauf nicht speichern. Der Unterschied von Meta liegt jedoch in der E2EE, die einen Schritt weiter geht, indem sie jeglichen Zugriff durch den Anbieter verhindert.

-

Anthropic mit Claude 4.7 Opus: Anthropic, bekannt für seinen Fokus auf KI-Sicherheit und -Ethik, hat strenge Daten-Governance-Richtlinien implementiert und bietet Unternehmensumgebungen mit strengen Vertraulichkeitsvereinbarungen an. Dennoch ist Metas Versprechen einer so robusten Verschlüsselung auf Benutzerebene in einem Massenmarktprodukt eine bedeutende Neuheit.

-

Google mit Gemini 3.1: Google hat auch Datenschutzkontrollen für seine Gemini 3.1-Nutzer eingeführt, die das Löschen von Aktivitäten ermöglichen und Modi anbieten, die die Datenaufbewahrung begrenzen. Während Google die Sicherheit seiner Systeme betont, setzt Metas Behauptung, dass "nicht einmal Meta Ihre Gespräche lesen kann", einen Datenschutzstandard, den viele andere Anbieter noch nicht erreicht oder auf die gleiche Weise beworben haben.

Metas Schritt ist daher nicht nur eine inkrementelle Verbesserung, sondern ein Versuch, die Spielregeln zu ändern und einen neuen Maßstab dafür zu setzen, was Nutzer in Bezug auf KI-Datenschutz erwarten können. Dieser Schritt könnte andere Technologiegiganten unter Druck setzen, ihre eigenen Datenschutzangebote zu überdenken und zu stärken, um wettbewerbsfähig zu bleiben.

Auswirkungen für Nutzer und die Industrie

Für die Nutzer stellt der Inkognito-Chat von Meta AI einen bedeutenden Fortschritt dar. Diejenigen, die Bedenken haben, persönliche Informationen, kreative Ideen oder sensible Anfragen mit einer KI zu teilen, haben nun eine Option, die eine unvergleichliche Vertraulichkeit verspricht. Dies könnte eine stärkere Experimentierfreudigkeit und Akzeptanz von Meta AI für Aufgaben fördern, die zuvor als zu heikel galten, um einem Chatbot anvertraut zu werden.

Aus industrieller Sicht ist Metas Entscheidung, die Ende-zu-Ende-Verschlüsselung in seinem KI-Produkt zu priorisieren, mutig. Sie könnte ein Katalysator für ein Wettrüsten um den Datenschutz unter KI-Entwicklern sein, bei dem Datensicherheit und Vertraulichkeit zu den Hauptunterscheidungsmerkmalen in einem zunehmend gesättigten Markt werden. Sie könnte auch Regulierungsbehörden dazu zwingen, die Datenschutzpraktiken von KI genauer zu prüfen und neue Standards festzulegen.

Ein strategischer Schritt von Meta

Diese Ankündigung ist nicht nur ein technisches Merkmal; sie ist ein strategischer Schritt von Meta. Nach Jahren der Kritik und Bußgeldern im Zusammenhang mit dem Datenschutz auf seinen sozialen Plattformen versuchen Zuckerberg und sein Team, das Vertrauen der Nutzer wiederherzustellen, insbesondere im aufstrebenden, aber kritischen Bereich der künstlichen Intelligenz. Indem Meta AI als die privateste Option positioniert wird, versucht das Unternehmen, sich zu differenzieren und eine datenschutzbewusste Nutzerbasis anzuziehen.

Die Initiative kommt auch zu einem Zeitpunkt, an dem Meta massiv in KI investiert und versucht, sie in alle seine Produkte zu integrieren, von Virtual Reality bis hin zu sozialen Medien. Eine "vollständig private" KI-Grundlage könnte die Säule sein, auf der zukünftige Innovationen aufgebaut werden, um den Nutzern zu versichern, dass ihre Interaktionen mit Meta-Technologien sicher und vertraulich sind. Es ist ein klarer Schritt in eine Zukunft, in der Privatsphäre keine optionale Funktion mehr ist, sondern eine grundlegende Erwartung.

Fazit

Die Einführung des Inkognito-Chats für Meta AI mit Ende-zu-Ende-Verschlüsselung ist ein wichtiger Meilenstein in der Entwicklung der künstlichen Intelligenz. Mark Zuckerbergs Versprechen, dass "niemand – nicht einmal Meta – Ihre Gespräche lesen kann", setzt einen neuen und ehrgeizigen Standard für den Datenschutz im Bereich der konversationellen KI. Da sich KI immer tiefer in unser Leben verwebt, wird die Fähigkeit, wirklich vertraulich mit ihr zu interagieren, unerlässlich. Meta hat den Fehdehandschuh hingeworfen, und es wird faszinierend sein zu beobachten, wie die Branche auf diese Datenschutzherausforderung reagiert und wie die Nutzer diese neue Ära der Interaktion mit künstlicher Intelligenz annehmen.

Español

Español English

English Français

Français Português

Português Deutsch

Deutsch Italiano

Italiano